Vybraná rizika generativní umělé inteligence

GenAI přináší mnoho užitečných možností, nese však s sebou také řadu velmi závažných rizik...

Generativní umělá inteligence (GenAI) přináší mnoho možností – od tvůrčího využití až po zrychlení práce. Nese však s sebou také řadu velmi závažných rizik. Některá jsou stále relativně nová a společnost je teprve objevuje, jiná jsou známá, ale jejich dopady se prohlubují. Mezi největší hrozby patří především zneužití technologií k podvodům, manipulacím a k narušování soukromí a lidské důstojnosti.

Hned úvodem je třeba zmínit, že umělá inteligence (např. tzv. velké jazykové modely či LLM) nemusí vždy generovat pravdivé výsledky a může si “vymýšlet” (tzv. halucinovat). To je dáno např. nedostatkem dat z dané oblasti, jejich reprezentativností, ale také způsobem, jak jsou jazykové modely trénovány – při tréninku je totiž lépe hodnoceno, když model alespoň něco odpoví (přestože chybně), než když nám informaci neposkytne, protože ji neví. Proto je důležité vždy si odpovědi ověřovat a nespoléhat na AI.

S trénováním úzce souvisí, co do umělé inteligence zadáváme – vzhledem k tomu, že se AI nástroje z našich dat učí, neměli bychom do nich nahrávat žádné osobní údaje či další citlivé materiály (např. zdravotní dokumentace, účetnictví apod.).

Jedním z hlavních zneužití GenAI je tvorba nepravdivých/falešných fotografií či videí (tzv. deep fake), které vypadají jako autentické, případně tzv. klonování lidského hlasu, kdy nástroje AI dokáží velmi věrně napodobit barvu hlasu a intonaci konkrétního člověka (politika, herce, zpěváka, kohokoli). AI technologie v současnosti umožňují vytvářet také přesvědčivá videa, které mohou být použita k manipulaci veřejného mínění, mohou posilovat extrémní tendence ve společnosti a probouzet násilí. Pomocí těchto produktů AI můžeme uživatele snadno přesvědčit o něčem, co se nikdy nestalo.

Deep fake fotografie (Open AI: Sora)

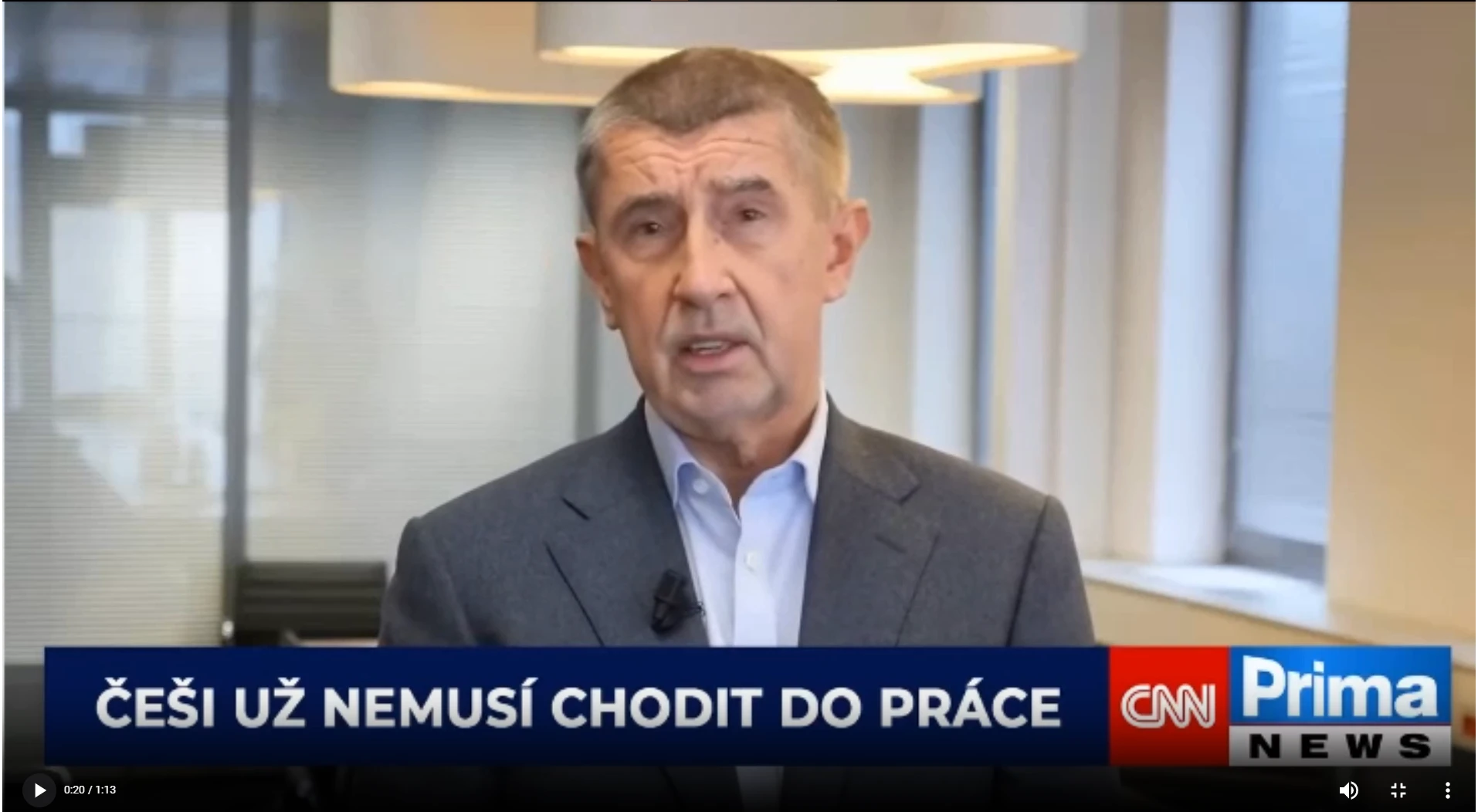

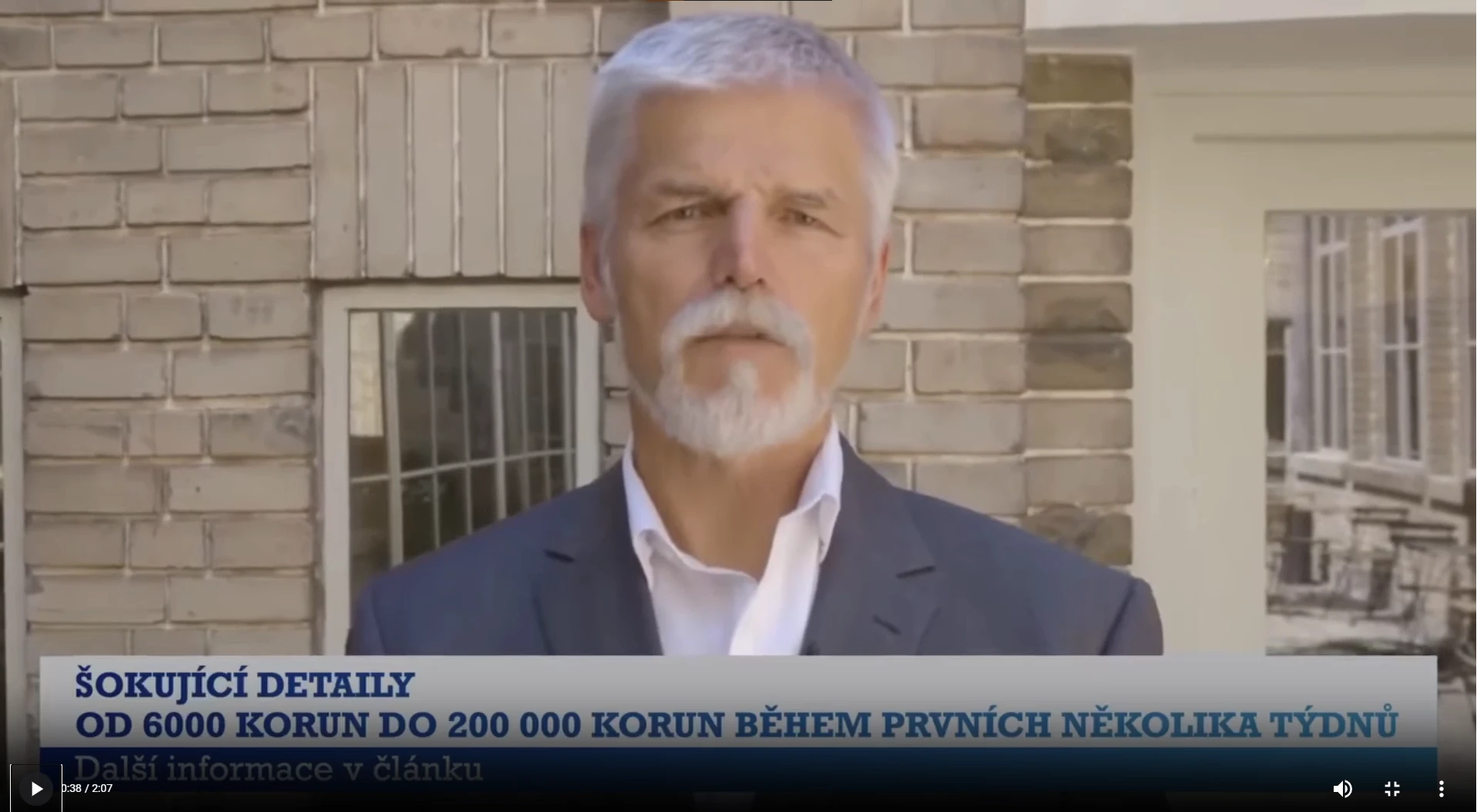

Příkladem zneužití umělé inteligence ve formě deep fake videí jsou různé typy podvodných reklam, nabízejících zázračné zbohatnutí prostřednictvím nejrůznějších “investic”, které potenciálním klientům nabízí např. známý politik, herec či zpěvák. V českém prostředí jsou tímto způsobem zneužívání např. expremiér Andrej Babiš, prezident Petr Pavel a další. Vše je však důmyslný podvod – uživatelé podvodnému videu naletí, zaplatí a výsledkem je pak ztráta peněz, v horším případě napadení celého účtu.

Ukázky těchto typů podvodů najdete např. na webu: https://ai.e-bezpeci.cz/rizika/.

Podvodná AI videa zneužívající známé osobnosti.

Deep nudes: vážné porušení soukromí a důsledky pro oběti

K dalším rizikům spojeným s GenAI patří fenomén deep nudes (známý také jako „svlékací aplikace“, AI deep nude nebo AI fake nude). Jde o zvláště závažnou formu zneužití generativní umělé inteligence – tyto aplikace totiž dokáží z fotografií či videí odstranit oblečení nebo vygenerovat nahé lidské tělo tak, že výsledek působí velmi reálně. Technologii může používat prakticky kdokoli – některé aplikace jsou volně dostupné, dokonce zdarma, a regulace této oblasti je zatím velmi slabá.

V Online poradně E-Bezpečí (www.napisnam.cz) se stále častěji setkáváme s případy, kdy si například spolužáci pomocí AI „svlékli“ spolužačku a následně AI fotografie začali šířit mezi ostatními. Takové jednání má devastující účinek na psychiku oběti a zároveň ukazuje, jak snadno mohou být moderní technologie zneužity i v dětském kolektivu. Oběti se často stydí situaci řešit, neví, na koho se obrátit, a mezitím čelí tlaku i posměchu okolí.

Deep nudes (vlevo původní fotografie, vpravo deep nude)

V České republice se v této oblasti připravuje novela trestního zákoníku, která má zavést nový paragraf „Zneužití identity k výrobě pornografie a její šíření“, podle kterého by výroba a distribuce deep nudes mohla být trestána odnětím svobody.

Mediální gramotnost a digitální kompetence

Příchod generativní umělé inteligence klade zvýšené nároky na mediální gramotnost a digitální kompetence uživatelů. Zatímco dříve bylo možné odhalit podvrženou fotografii či video poměrně snadno (AI např. chybně generovala počty prstů), dnes je kvalita výstupů natolik vysoká, že běžný člověk často nedokáže rozeznat, zda jde o skutečný, nebo vygenerovaný materiál. To platí nejen pro fotografie, ale čím dál častěji i pro videa a audiozáznamy.

Rozpoznávání falešného obsahu se tak stává jednou z klíčových dovedností 21. století. Lidé se musí učit kriticky posuzovat informace, ověřovat zdroje a nevěřit bezhlavě každému obsahu, který působí autenticky. Nedostatek těchto dovedností činí uživatele zranitelnějšími vůči manipulacím, podvodům i kyberšikaně.

Generativní umělá inteligence nabízí revoluční možnosti, ale její zneužití přináší velmi reálné hrozby. Podvody s falešnými investicemi, deepfake videa nebo šíření deep nudes dokážou zasáhnout jednotlivce i celou společnost. Oběti přitom čelí nejen ztrátě soukromí, ale i vážným psychickým dopadům. Současně se ukazuje, že schopnost rozlišit pravdu od podvrhu je čím dál obtížnější a že se bez posílení mediální gramotnosti a digitálních kompetencí uživatelů neobejdeme.

Proto je nutné kombinovat legislativní opatření, technické nástroje, vzdělávání i podporu obětí tak, aby výhody AI nepřevážily nad jejími škodami.

Další informace o rizicích spojených s AI najdete na webu: https://ai.e-bezpeci.cz/rizika/.

prof. Mgr. Kamil Kopecký, Ph.D.

Institut výzkumu a vzdělávání v oblasti digitálních technologií a kyberbezpečnosti & E-Bezpečí, Pedagogická fakulta Univerzity Palackého v Olomouci